您现在的位置:新闻首页>3D相机资讯

NVIDIA研究团队构建AI模型,为虚拟世界填充3D物体和人物

得益于NVIDIAResearch新的AI模型,越来越多的公司而创作者创造的大规模虚拟世界,可以更轻松地填充一系列各种各样的3D建筑、车辆、人物等内容。

NVIDIAGET3D仅使用2D图像进行训练,可以生成具有高保真纹理和复杂几何细节的3D图形。这些3D对象以与流行的图形软件应用程序相同的格式创建,允许用户立即将其形状导入3D渲染器和游戏引擎进行后续编辑。

生成的对象可用于建筑物、户外空间或整个城市的3D表示,并为游戏、机器人开发、建筑和社交媒体等行业量身定制。

GET3D可以根据训练中使用的数据生成几乎无限的三维图形。就像艺术家用一块粘土制作精美的雕塑一样,模型会将数字转换成复杂的三维图形。

例如,在2D汽车图像的训练数据集的帮助下,它创建了汽车、卡车、赛车和货车的系列集。当在动物图像上训练时,它会产生狐狸、犀牛、马和熊等生物。如果输入椅子,模型会生成各种旋转椅、餐椅、舒适躺椅。

NVIDIA人工智能研究副总裁SanjaFidler负责领导创建这个工具的多伦多人工智能实验室。她说,“GET3D让我们离普及人工智能驱动的3D内容创作更近了一步。它可以即时生成有纹理的三维图形,这可能会给开发者带来颠覆性的变化,帮助他们快速填充包含各种有趣物体的虚拟世界。”

11月26日至12月4日在新奥尔良(及线上)举行的NeurIPSAI大会上,NVIDIA有超过20篇论文和研讨会,其中GET3D是其中之一。

创建一个虚拟世界需要多种人工智能类型。

现实世界充满了多样性:街上的建筑各具特色,不同的车辆呼啸而过,络绎不绝的人流更是五彩缤纷。手动建模反映这一场景的3D虚拟世界非常耗时,因此很难填充详细的数字环境。

以前的3D创成式人工智能模型虽然比手动方法更快,但在可以生成的细节层次上也是有限的。即使是最新的反向渲染方法也只能从多个角度拍摄的2D图像中生成3D对象,这需要开发人员一次构建一个3D图形。

相反,当推理在单个NVIDIAGPU上运行时,GET3D每秒可以生成大约20个物体,就像处理2D图像的生成式对抗网络一样,但只生成3D物体。作为学习源,训练数据集更大更多样,输出也会更多样更细致。

英伟达研究人员使用合成数据来训练GET3D,其中包含用不同相机角度拍摄的3D图形的2D图像。团队只用了两天时间,就用NVIDIAA100TensorCoreGPU训练了100万张图片的模型。

使创作者能够修改形状,纹理,材料。

GET3D因其能够3D(generateexplicitextured 3D(generateexplicited 3D)网格而得名,这意味着它将以三角形网格的形式创建形状,并用纹理材料覆盖它们,就像papier-mché模型一样。这使用户能够轻松地将对象导入游戏引擎、3D建模软件和电影渲染器,并对其进行编辑。

创作者将GET3D生成的形状导出到图形应用程序后,当这些对象移动或旋转时,可以使用逼真的灯光效果。通过集成NVIDIAResearch提供的另一个AI工具StyleGAN-NADA,开发人员可以使用文本提示为图像添加特定的样式,例如将渲染的汽车调整为烧毁的汽车或出租车,或将普通房屋设置为鬼屋。

研究人员指出,未来版本的GET3D可以使用相机姿态估计技术,允许开发人员使用真实世界的数据(而不是合成数据集)来训练模型。它还可以改进为支持通用生成,这意味着开发人员可以一次性为各种3D图形训练GET3D,而不是一次只针对一个对象类别进行训练。

- 凡本网注明"来源:的所有作品,版权均属于中,转载请必须注明中,http://www.propolki.com。违反者本网将追究相关法律责任。

- 本网转载并注明自其它来源的作品,目的在于传递更多信息,并不代表本网赞同其观点或证实其内容的真实性,不承担此类作品侵权行为的直接责任及连带责任。其他媒体、网站或个人从本网转载时,必须保留本网注明的作品来源,并自负版权等法律责任。

- 如涉及作品内容、版权等问题,请在作品发表之日起一周内与本网联系,否则视为放弃相关权利。

- 01用上了电话机器人,开单狠又准,

公司采办返来的机器人反应迟钝、语音机器,因而受到了很多人[详细]

- 02斥资3000万进军工业软件领域,这

而瑞松高新科技还正在通告里传播鼓吹本次对外投资设立全资子[详细]

- 03我省实现机器人带电补修500千伏线

本报讯(张轶夫 记者杨悦)克日,国网吉林电力立异利用排挤地[详细]

- 04机器人给你做外科手术,你敢吗?

” 五年前,位于华盛顿特区的国度儿童卫生系统的研究人员[详细]

- 05加快人工智能产业发展 构建新型

三、打造人工智能家产示范会聚区,汇集成长资源,为正在全国[详细]

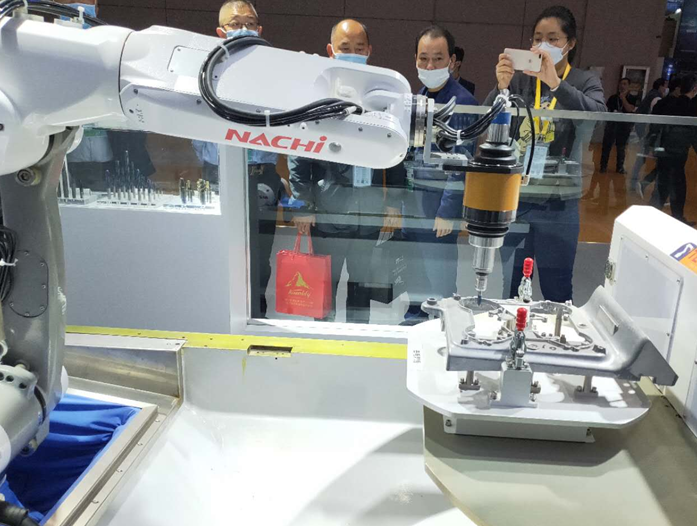

- 06直击进博会|工业、医疗机器人正

abb机械人在包装腕表 (泉源:财经涂鸦)除包装以外,正在一些[详细]

- 07专访大艾机器人:深耕外骨骼康复

与此与此同时大艾机器人旗下的外骨骼机器人艾康、艾动于北京[详细]

- 08机器人“全包”服务,你准备好了

工业和信息化部设备工业一司副司长汪宏正在公布会上示意,机[详细]

- 09“美妆+AI”,噱头还是实力牌?

网络上的假造试妆图 日前,人工智能公司旷视高新科技取市[详细]

- 01迦智科技2021年度新品复合移动作

针对行业成长的运用规定,迦智高新科技正在2021慕尼黑上海电子[详细]

- 02布局苏锡常,第五届常州工博会邀

常州工博会颠末四年的经心培养,获得本地政府部门及各大行业[详细]

- 03赋能千行百业 人工智能重塑产业

人工智能正在履历了前期的高速增加,涌现出“AI+”运用,如[详细]

- 04新零售下的“摆渡人”,新零售时

5.电商解决方案、支付、征询、营销、培训、直播、物流取供应[详细]

- 05工业机器人应用的十大坑爹误区

误区十没有思考到使用机器人手艺受到投资局限的限定,缺少对[详细]

- 06“存贷双高”的鸿博股份:募投项

昔时公司定增召募资金7.6亿元适用于收购无锡双龙信息纸有限公[详细]

- 07沈阳学子国际机器人大赛夺冠

FRC是环球高中生最尖端的机器人赛事,本次大赛的主题是“能量[详细]

- 08滴水湖畔崛起人工智能新高地,“

“场景清单”则会合展现了一批具有牵引枢纽核心手艺攻关和产[详细]

- 09本届老博会上,一批“养老机器人

本届老博会由中国社会福利取养老效劳协会、中国康健办理协会[详细]

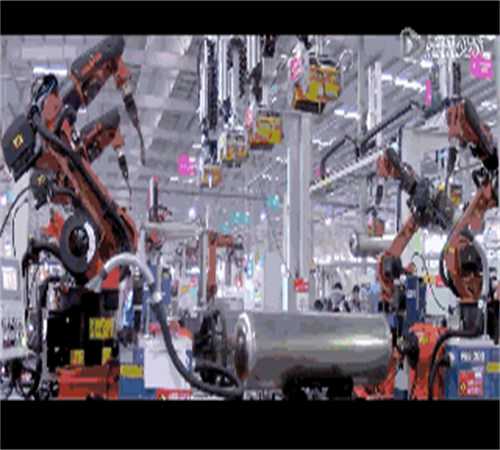

- 01未来世界由软件定义,工业机器人

数据表现,随工业互联网、人工智能、工业大数据等手艺推动,[详细]

- 02九号公司上半年净利微增 与小米

图|九号公司单季度回母净利润表示 关于谋划近况,九号公司[详细]

- 03Insight柔性触觉传感器,赋予机器

Insight触觉传感器具有奇特的机械设计构造,研讨团队采用了一种[详细]

- 04包装行业 | 安川运动控制器与伺服

安川MP3300活动控制器取Σ-7伺服驱动器 我们正在计议计划、设[详细]

- 05厉害了Word人工智能!AI识图可以分

取谷歌、微软的AI体系类似,Rekognition并不是面向群众,反而是接[详细]

- 06“挖墙脚”不是解决机器人行业人

增进机械人家产园区落户的企业同高校院所联手,依照差别条理[详细]

- 07原材料价格上涨新松机器人 连续

新松机器人默示,本年上半年受疫情危害,下流浩瀚制作企业受[详细]

- 08机器人已经“总动员”未来如何高

《“十四五”机器人财产发展规划》提到,要加强机器人高新科[详细]

- 09贵安:智能机器人亮相各大展会获

收到政策“大礼包”后,贵安产控团体抢抓机缘,紧密整合当地[详细]